Future Life Lab

Este laboratorio está dentro de Taotian Group y se presenta públicamente como el equipo detrás de HappyHorse 1.0. Todo apunta a que es el primer gran lanzamiento público con el nombre HappyHorse.

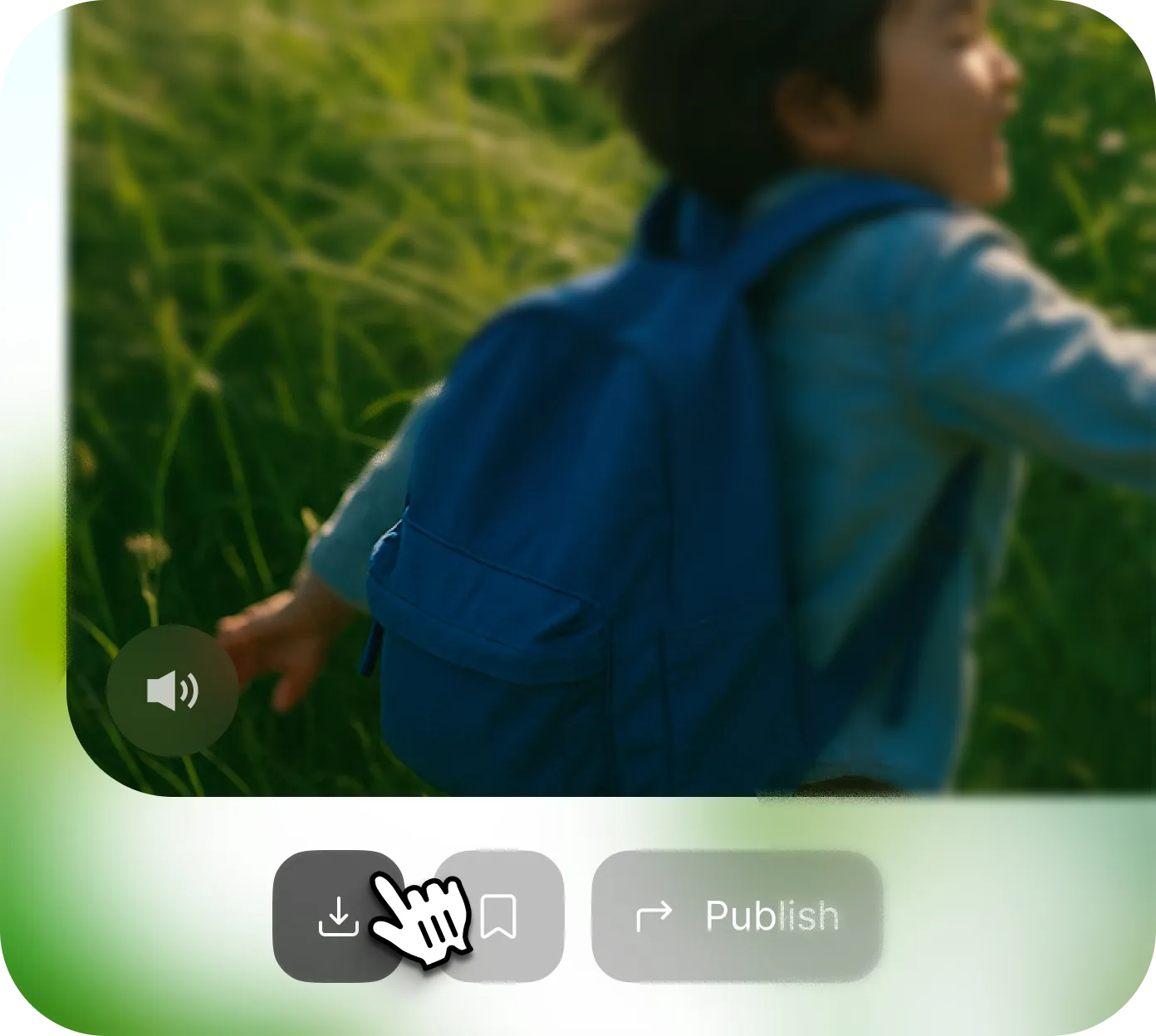

Happy Horse 1.0 está creciendo con fuerza en pruebas públicas a ciegas, con primeros planos sólidos, movimiento natural y encuadres muy cinematográficos. Los detalles oficiales siguen siendo limitados, pero el ruido de #1 ya es imposible de ignorar.

Basado en demos públicos de X.com y clips del arena de Artificial Analysis.

Los clips públicos de yoga y movimiento sugieren que Happy Horse 1.0 maneja poses de cuerpo completo con extremidades estables, transferencias de peso creíbles e interacción limpia con el entorno.

Las demos públicas más fuertes se apoyan en el rostro: arrugas, poros, pestañas y transiciones suaves de luz se mantienen sin el acabado encerado que suele romper el realismo.

Contactos pequeños como guiar un títere o manipular objetos artesanales se mantienen coherentes, justo donde muchos modelos más débiles pierden geometría y puntos de contacto.

Las tomas románticas y emocionales muestran continuidad facial fluida, buena profundidad y composición más fuerte, acercando los clips a una cobertura live-action pulida.

Las secuencias de carrera y movimiento rápido sugieren que el modelo preserva mejor la identidad del sujeto y la estructura corporal durante la velocidad.

| Característica | HappyHorse 1.0 | Seedance 2.0 | Veo 3.1 | Sora 2 |

|---|---|---|---|---|

| Acceso actual | Blind test / preview only | Available | Available | Available |

| Nivel de detalle oficial | Limited | High | High | High |

| Comparativas públicas en arena | Artificial Analysis | Public demos | Public demos | Public demos |

| Reels públicos más largos vistos | 15s | 15s | 8s | 15s |

| Audio público observado | Yes | Yes | Yes | Yes |

| Transparencia de especificaciones públicas | ||||

| Realismo humano | ||||

| Fidelidad en primeros planos | ||||

| Naturalidad del movimiento | ||||

| Plausibilidad física | ||||

| Encuadre cinematográfico |

Mientras Happy Horse 1.0 siga en fase previa, usa esta página como checklist de lanzamiento.

Step 1 of 3

Visita la landing de Happy Horse 1.0 en Sora 2 y mantén el preset por defecto del generador. Como el modelo sigue marcado como Coming Soon, esta página funciona por ahora como tracker de lanzamiento y archivo de demos.

Step 2 of 3

Revisa los clips públicos y videos de ejemplo recopilados desde X.com. Observa qué tipos de prompts resaltan mejor los close-ups, la interacción con objetos, la acción cinematográfica y las escenas guiadas por audio.

Step 3 of 3

En cuanto Happy Horse 1.0 esté disponible en Sora 2, este generador pasará del modo preview a creación real. Entonces podrás refinar prompts, subir referencias y generar clips desde la misma página.

La información pública del equipo apunta a Taotian Group de Alibaba, con Zhang Di al frente del proyecto tras haber ayudado a construir Kling AI. La historia sigue teniendo algo de misterio, pero la señal del equipo ya es mucho más clara.

Este laboratorio está dentro de Taotian Group y se presenta públicamente como el equipo detrás de HappyHorse 1.0. Todo apunta a que es el primer gran lanzamiento público con el nombre HappyHorse.

El sitio público de HappyHorse señala a Zhang Di como líder. Antes fue vicepresidente de Kuaishou y dirigió la tecnología de Kling AI antes de unirse a Alibaba.

Ese recorrido ayuda a explicar por qué el modelo está recibiendo tanta atención tan rápido: el equipo ya tiene experiencia lanzando sistemas avanzados de video con IA.

El mensaje público apunta a un lanzamiento open source, con más detalles sobre repositorio y pesos del modelo una vez llegue la apertura más amplia.

Ahora mismo, Happy Horse 1.0 se entiende mejor como un modelo de video misterioso que aparece en pruebas ciegas públicas, reels comparativos y publicaciones de la comunidad. La señal pública más fuerte hasta ahora viene de las comparativas de Artificial Analysis y de clips demo en X.com.

No. A fecha del 9 de abril de 2026, Happy Horse 1.0 todavía no es un modelo de generación activo en Sora 2. Esta página es una preview Coming Soon con demos públicas y un preset listo para el día del lanzamiento.

Según el sitio público de HappyHorse AI, HappyHorse 1.0 proviene de Future Life Lab dentro de Taotian Group de Alibaba y está liderado por Zhang Di, ex vicepresidente de Kuaishou y ex responsable de Kling AI.

Los clips públicos sugieren primeros planos humanos muy fuertes, movimiento corporal estable, buena interacción con props y encuadre cinematográfico. Por eso ha empezado a destacar en comparativas ciegas.

Varios reels públicos incluyen sonido sincronizado y prompts guiados por audio, lo que sugiere que el flujo tiene sensibilidad al audio. Aun así, la hoja completa de capacidades oficiales todavía no se ha confirmado.

Algunos sitios de terceros dicen que podría haber una liberación de pesos abiertos, pero los términos oficiales todavía no están claros. Hasta ver una página oficial o repositorio confirmado, lo prudente es tratar ese punto como no verificado.

Se basan en clips públicos de Happy Horse 1.0 publicados en X.com y en videos comparativos de la arena de Artificial Analysis. La página resume lo que ya puede observarse antes de que se abra un acceso más amplio.

Espera que el preset del generador de esta página se convierta en la entrada directa. Cuando el modelo esté activo, podrás escribir prompts, subir referencias y generar videos desde esta misma landing sin cambiar de flujo.

Prueba otros potentes modelos de generación de video IA disponibles en botgo.ai.

Modelo multimodal de referencia de ByteDance con control por frames y flujos conscientes del audio

✓ DisponibleModelo cinematográfico de Google con buena fidelidad al prompt y salida 4K

✓ DisponibleModelo de OpenAI centrado en física realista y continuidad entre múltiples planos

✓ DisponibleConvierte texto, imágenes y audio en videos cinematográficos con narración multicámara y precisión a nivel de fotograma

Seguir lanzamiento de Happy Horse 1.0