Future Life Lab

Das Labor gehört zur Taotian Group und wird öffentlich als Team hinter HappyHorse 1.0 genannt. Alles deutet darauf hin, dass dies der erste große öffentliche Release unter dem Namen HappyHorse ist.

Happy Horse 1.0 gewinnt in öffentlichen Blindtests rasant an Aufmerksamkeit, mit starken Close-ups, natürlicher Bewegung und filmischer Bildsprache. Offizielle Details sind noch begrenzt, aber der #1-Hype ist längst nicht mehr zu übersehen.

Basierend auf öffentlichen X.com-Demos und Clips aus der Artificial-Analysis-Arena.

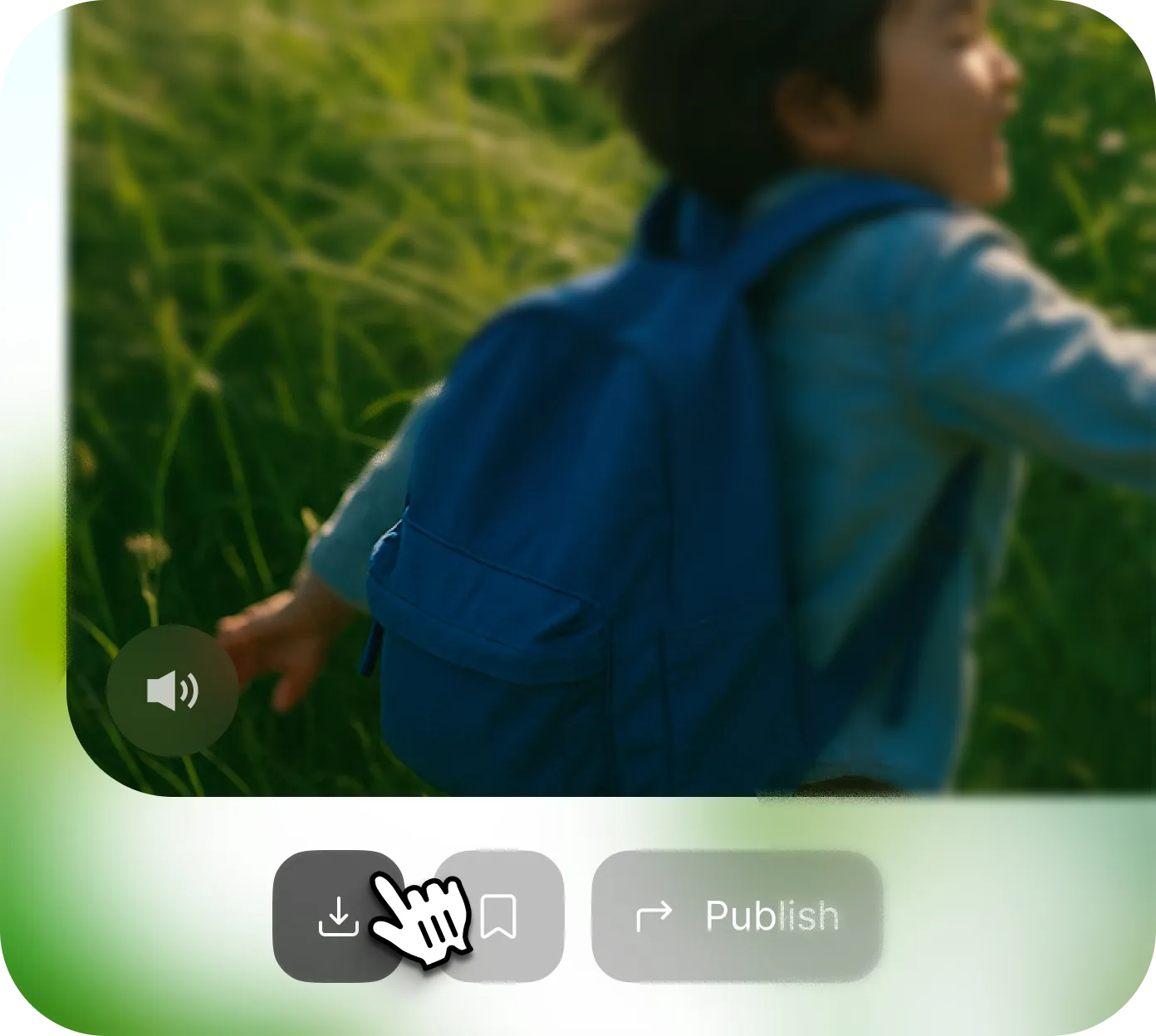

Öffentliche Yoga- und Bewegungsclips deuten darauf hin, dass Happy Horse 1.0 Ganzkörperposen mit stabilen Gliedmaßen, glaubwürdiger Gewichtsverlagerung und sauberer Interaktion mit der Umgebung verarbeitet.

Die stärksten öffentlichen Demos setzen auf Gesichts-Nahaufnahmen, bei denen Falten, Poren, Wimpern und weiche Lichtübergänge erhalten bleiben, ohne den wächsernen Look vieler schwächerer Modelle.

Kleine Kontaktsituationen wie das Führen einer Puppe oder der Umgang mit handwerklichen Objekten bleiben visuell stimmig – genau dort, wo schwächere Modelle oft Geometrie und Kontaktpunkte verlieren.

Romantische und emotional getriebene Einstellungen zeigen flüssige Gesichtskontinuität, gute Tiefenwirkung und stärkere Komposition, sodass die Clips näher an polierte Live-Action-Aufnahmen herankommen.

Renn- und bewegungsintensive Clips deuten darauf hin, dass das Modell Identität und Körperstruktur des Subjekts bei hoher Geschwindigkeit besser bewahrt.

| Funktion | HappyHorse 1.0 | Seedance 2.0 | Veo 3.1 | Sora 2 |

|---|---|---|---|---|

| Aktueller Zugang | Blind test / preview only | Available | Available | Available |

| Offizieller Detailgrad | Limited | High | High | High |

| Öffentliche Arena-Vergleiche | Artificial Analysis | Public demos | Public demos | Public demos |

| Längste öffentlich gesehene Clips | 15s | 15s | 8s | 15s |

| Beobachtetes öffentliches Audio | Yes | Yes | Yes | Yes |

| Transparenz öffentlicher Spezifikationen | ||||

| Menschlicher Realismus | ||||

| Detailtreue in Nahaufnahmen | ||||

| Natürlichkeit der Bewegung | ||||

| Physikalische Plausibilität | ||||

| Filmische Bildkomposition |

Solange Happy Horse 1.0 noch in der Preview-Phase ist, kannst du diese Seite als Launch-Checkliste nutzen.

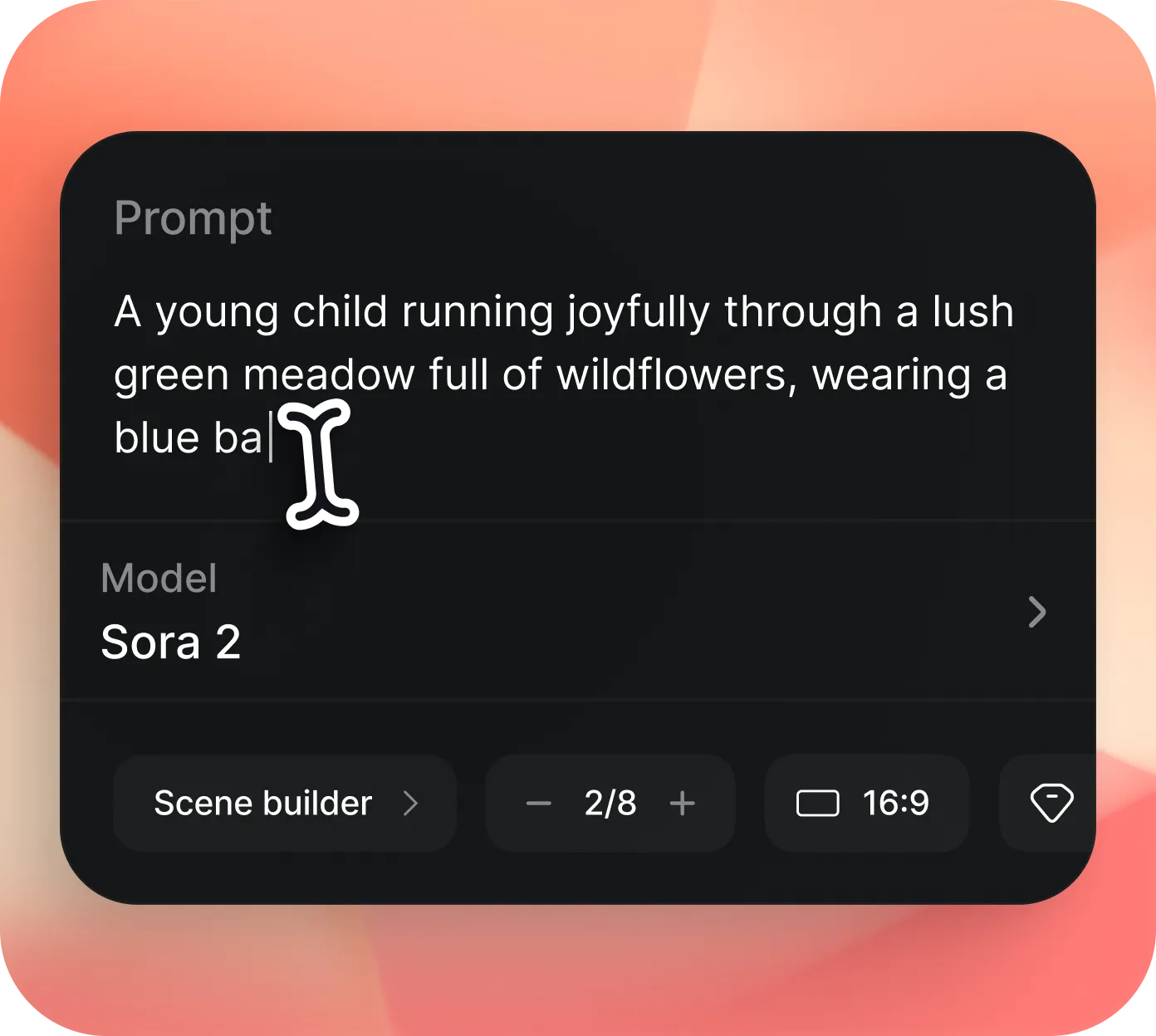

Step 1 of 3

Besuche die Happy-Horse-1.0-Landingpage auf Sora 2 und lasse das Standard-Preset des Generators ausgewählt. Da das Modell noch als Coming Soon markiert ist, dient diese Seite aktuell als Launch-Tracker und Demo-Archiv.

Step 2 of 3

Sieh dir die öffentlichen Arena-Clips und Beispielvideos von X.com an. Achte darauf, welche Prompts Nahaufnahmen, Objektinteraktion, filmische Action und audio-getriebene Szenen am besten hervorheben.

Step 3 of 3

Sobald Happy Horse 1.0 auf Sora 2 verfügbar ist, wechselt dieser Generator vom Preview-Modus in den Live-Betrieb. Dann kannst du Prompts verfeinern, Referenzen hochladen und Clips direkt auf derselben Seite erzeugen.

Öffentliche Teamangaben verweisen auf Alibabas Taotian Group, mit Zhang Di an der Spitze des Projekts, nachdem er zuvor beim Aufbau von Kling AI mitgewirkt hat. Das Modell bleibt geheimnisvoll, aber das Signal rund um das Team ist jetzt deutlich klarer.

Das Labor gehört zur Taotian Group und wird öffentlich als Team hinter HappyHorse 1.0 genannt. Alles deutet darauf hin, dass dies der erste große öffentliche Release unter dem Namen HappyHorse ist.

Die öffentliche HappyHorse-Seite nennt Zhang Di als Leiter. Er war zuvor Vizepräsident bei Kuaishou und leitete vor seinem Wechsel zu Alibaba die Kling-AI-Technologie.

Dieser Hintergrund erklärt, warum das Modell so schnell so viel Aufmerksamkeit bekommt: Das Team hat bereits Erfahrung mit anspruchsvollen KI-Videosystemen in der Praxis.

Die öffentliche Botschaft deutet auf einen Open-Source-Weg hin, wobei Details zu Repository und Gewichten nach dem breiteren Launch erwartet werden.

Derzeit lässt sich Happy Horse 1.0 am besten als rätselhaftes Videomodell beschreiben, das in öffentlichen Blindtests, Vergleichsreels und Community-Posts auftaucht. Das stärkste öffentliche Signal kommt bisher aus den Artificial-Analysis-Arena-Vergleichen und X.com-Democlips.

Nein. Stand 9. April 2026 ist Happy Horse 1.0 noch kein aktives Generierungsmodell auf Sora 2. Diese Seite ist eine Coming-Soon-Vorschau mit öffentlichen Demos und einem vorbereiteten Preset für den Launch-Tag.

Laut der öffentlichen HappyHorse-AI-Website stammt HappyHorse 1.0 aus dem Future Life Lab innerhalb der Taotian Group von Alibaba und wird von Zhang Di geleitet, dem ehemaligen Vizepräsidenten von Kuaishou und früheren Leiter von Kling AI.

Die öffentlichen Clips deuten auf ungewöhnlich starke menschliche Nahaufnahmen, stabile Körperbewegung, gute Requisiteninteraktion und sicheres filmisches Framing hin. Deshalb taucht das Modell in Blindvergleichen immer häufiger auf.

Mehrere öffentliche Reels enthalten synchronisierten Ton und audio-geführte Prompts, was auf einen audio-bewussten Workflow hindeutet. Das vollständige offizielle Capability-Sheet ist jedoch noch nicht bestätigt.

Einige Drittseiten behaupten, dass eine Open-Weights-Veröffentlichung geplant sein könnte, aber offizielle Release-Bedingungen sind noch unklar. Bis eine formale Launch-Seite oder ein bestätigtes Repository existiert, sollte Open Source als nicht verifiziert gelten.

Sie basieren auf öffentlichen Happy-Horse-1.0-Clips von X.com und Vergleichsvideos aus der Artificial-Analysis-Arena. Die Seite soll zusammenfassen, was öffentlich bereits beobachtet werden kann, bevor breiterer Zugang eröffnet wird.

Erwarte, dass das Generator-Preset auf dieser Seite zum direkten Einstieg wird. Sobald das Modell live ist, kannst du Prompts schreiben, Referenzen hochladen und Videos direkt auf derselben Landingpage erzeugen.

Probieren Sie weitere leistungsstarke KI-Videogenerierungsmodelle auf botgo.ai aus.

Verwandeln Sie Text, Bilder und Audio in cinematische Videos mit Multi-Kamera-Storytelling und Frame-Level-Präzision

Happy Horse 1.0 Launch verfolgen